W aplikacji od OpenAI na komputery Apple odkryto poważny problem. Po drobnej modyfikacji plików programu okazało się, że treści rozmów prowadzonych przez użytkownika były przechowywane lokalnie w formie czystego tekstu.

Trudno sobie wyobrazić choć jeden dzień bez kolejnej wiadomości dotyczącej AI. Technologia ta, która dość nagle wkroczyła do naszego życia, raczej nieprędko spowszednieje. Dziś jednak nie będziemy ekscytować rewolucją kolejnej dziedziny życia, która za sprawą sztucznej inteligencji zupełnie się odmieni. Tym razem zajmiemy się typowym błędem w oprogramowaniu.

Na szczęście producent aplikacji wydał już stosowną aktualizację, zatem jeśli korzystacie z najnowszej wersji ChatGPT dla macOS możecie odetchnąć z ulgą – bug został naprawiony. Niemniej jednak charakter odkrytej usterki powinien jeszcze raz zwrócić uwagę na to, by uważać jakie dane wpisujemy w okno czatu podczas konwersacji z modelami AI.

ChatGPT na macOS przechowywał lokalnie treści rozmów w formie nieszyfrowanego tekstu

Pedro José Pereira Vieito w poście opublikowanym na portalu Threads zademonstrował, jak łatwo odczytać treść rozmowy prowadzonej w oknie oficjalnego klienta ChatGPT od OpenAI na macOS. Programista sam napisał prostą aplikację, która wyświetlała dokładny zapis konwersacji, a co ciekawe zapytał nawet ChatGPT czy rozmowa, którą prowadzą, jest poufna. W odpowiedzi możemy przeczytać, że oczywiście, żadne przekazane informacje nie wydostaną się na zewnątrz. Ujawniona przez Pereirę Vieito luka pozwalała na pobranie kompletnego zapisu konwersacji tak naprawdę każdej osobie lub złośliwej aplikacji, której udałoby się dostać do komputera ofiary. Co gorsza, przechowywana lokalnie treść nie była w żaden, nawet najprostszy sposób zaszyfrowana.

Post by @pvieitoView on Threads

W tym momencie należałoby zadać sobie pytanie, jak to możliwe, że program napisany przez niezależnego dewelopera był w stanie odczytać pliki należące do innej aplikacji bez żadnego problemu, skoro Apple już 6 lat temu wraz z premierą macOS Mojave zablokowało dostęp aplikacjom do prywatnych danych użytkowników bez udzielenia przez nich wyraźnej zgody. Otóż OpenAI nie udostępniło swojego programu w App Store, wskutek czego, oferowana aplikacja nie podlega ścisłym regułom wprowadzonym przez Apple. Z tego też powodu, dane użytkowników musiały być przechowywane lokalnie, pozostając dostępnymi dla innych aplikacji. W żadnym razie jednak nie musiały być w formie otwartego tekstu.

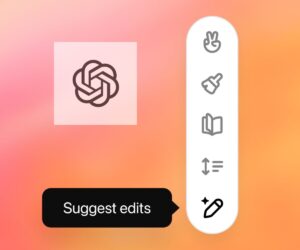

Dziennikarz portalu The Verge zapytał programistę, który odkrył lukę, jak wpadł on na to, że taki problem może w ogóle istnieć. Pereira Vieito odpowiedział, że właśnie fakt dystrybucji programu nieoficjalnym kanałem (poza App Store) skłonił go do zastanowienia się nad tym, gdzie w takim razie przechowywane są wrażliwe dane. W ten sposób wnikliwy deweloper wpadł na pomysł zmiany nazwy pliku, w którym jak się okazało, zapisywane były treści rozmów. W odpowiedzi na pytanie ze strony The Verge, rzeczniczka OpenAI przekazała, że problem został już rozwiązany.

Jesteśmy świadomi tego problemu i wydaliśmy nową wersję aplikacji, która szyfruje te rozmowy. Dokładamy wszelkich starań, aby zapewnić użytkownikom przydatne rozwiązania przy jednoczesnym zachowaniu naszych wysokich standardów bezpieczeństwa w miarę rozwoju naszej technologii.

Pereira Vieito potwierdził też na portalu Threads, że rozmowy prowadzone przez klienta ChatGPT są teraz szyfrowane. Dziennikarz The Verge dodał także, że po aktualizacji aplikacji (do wersji v1.2024.171), program napisany przez Pereira Vieito przestał działać. Przyznam, że czas reakcji OpenAI jest w przypadku godny pochwały. Jednocześnie można odnieść wrażenie, że problem nie wystąpiłby, gdyby aplikacja była dystrybuowana poprzez Apple Store. Tak czy inaczej, pamiętajcie, że o ile świadomie nie wyłączycie pewnych opcji, OpenAI i tak może używać treści waszych rozmów do dalszego rozwijania swojego modelu AI.

![DailyWeb testuje: [WYWIAD] Które języki tłumaczy się najtrudniej? O AI, pięknych urządzeniach, projektowaniu produktów dla seniorów i młodych – rozmawiamy z Kamilem Cupiałem z VASCO](https://alfred.dailyweb.pl/wp-content/uploads/2022/01/wywiad-1-300x250.png)